هوش مصنوعی فرصتهای جدیدی برای توسعه و رقابت در اختیار رهبران قرار میدهد، اما چطور میتوانیم کسب و کار خود را با این تکنولوژی جدید و نوآورانه همراه کنیم؟ آیا میتوان به هوش مصنوعی برای انجام کارها اعتماد کرد؟ چطور با خیالی آسوده و مسئولیتپذیرانه هوش مصنوعی را در کسب و کار خود به کار ببریم؟ برای دریافت پاسخ این سوالات، با ما همراه شوید.

مقدمهای بر تأثیر هوش مصنوعی در سازمانها

هوش مصنوعی، از کارگاه تا اتاق هیئتمدیره، ابزاری تحولآفرین در چشمانداز کسبوکارهاست که به سازمانها قدرت میدهد تا فرایندهای کاری را دگرگون کنند و بهرهوری را افزایش دهند. شدت این تغییرات تا حد خیلی زیادی پارامترهای رهبری کسبوکار را در سال ۲۰۲۴ تغییر داده و فرصتهای جدیدی برای افزایش رقابتپذیری و رشد ایجاد کرده است. در کنار این فرصتها، پیچیدگی هوش مصنوعی – به ویژه هوش مصنوعی مولد – تهدیدات و خطرات جدیدی را به همراه داشته است. رهبران کسبوکار در همه بخشها با دغدغههای جدیدی در زمینه امنیت دادهها، حریم خصوصی، اخلاق و مهارتها روبهرو هستند.

برای بررسی جزئیات بیشتر این موضوع، شرکت IBM یک مطالعه با عنوان «رهبری در عصر هوش مصنوعی» را درخواست داده است. در این مطالعه از بیش از ۱۶۰۰ مدیر ارشد اروپایی مورد نظرسنجی قرار گرفتهاند تا نظر خود را در مورد چگونگی تحول نقش رهبران شرکتها با انقلاب هوش مصنوعی به اشتراک بگذارند. این در حالیست که این مدیران تلاش دارند فرصتها را به حداکثر برسانند و در عین حال، خطرات احتمالی هوش مصنوعی را در چشمانداز قانونی و اخلاقی مدیریت کنند.

تقاضای فزایندهِ هوش مصنوعی در اروپا

از آنجا که هفت کشور از ده کشور نوآور جهان در اروپا قرار دارند، این منطقه برای بهرهبرداری از قانون هوش مصنوعی اتحادیه اروپا، که به زودی تصویب خواهد شد، در موقعیت خوبی قرار دارد. قانون هوش مصنوعی اتحادیه اروپا اولین چارچوب جامع نظارتی در جهان را ارائه میدهد. انتظار میرود که این اطمینان و وضوح نظارتی، سرمایهگذاریهای بیشتر و مشارکتکنندگان جدیدی را به خود جذب کند، که در نهایت به نفع اکوسیستم هوش مصنوعی اروپا خواهد بود.

با وجود این پیشزمینه امیدوارکننده، جای تعجب نیست که استفاده از هوش مصنوعی مولد در صدر اولویتهای مدیران عامل برای سال ۲۰۲۴ قرار گرفته است؛ به طوری که از رهبران کسبوکار مورد بررسی، ۸۲٪ آنها یا هوش مصنوعی مولد را به کار گرفتهاند یا قصد دارند در سال جاری این کار را انجام دهند. این احساس اضطرار فزاینده ناشی از تمایل به بهبود کارایی از طریق خودکارسازی فرآیندهای روتین و آزاد کردن کارکنان برای انجام کارهای با ارزش افزوده بیشتر است، همچنین بهبود تجربه مشتری و دستیابی به نتایج بهتر.

با وجود این اشتیاق، نگرانیهای مربوط به امنیت و حریم خصوصی باعث کاهش سرعت پذیرش شده است. ۸۸٪ از رهبران کسبوکار نسبت به پتانسیل هوش مصنوعی در کسبوکار خود مشتاق و خوشبین بودند، در حالی که ۴۴٪ هنوز احساس آمادگی کافی برای استفاده از این فناوری را نداشتند. امنیت و حریم خصوصی دادهها (۴۳٪)، تأثیر بر نیروی کار (۳۲٪) و پیامدهای اخلاقی (۳۰٪) به عنوان سه چالش اصلی که رهبران کسبوکار با آن روبهرو هستند، شناسایی شدهاند. در نتیجه، مدیران اکنون مجبورند علاوه بر تمرکز بر مزایای مالی هوش مصنوعی، به هزینهها و خطرات اجتماعی مرتبط با آن نیز توجه کنند.

عصری جدید برای رهبری

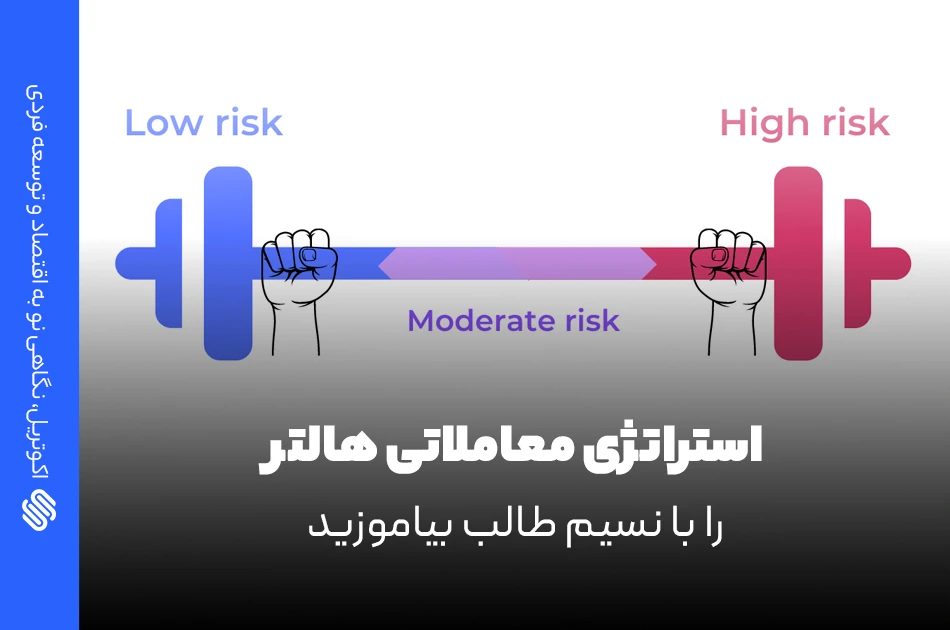

رهبری در عصر هوش مصنوعی نیازمند آن است که مدیران اجرایی بین پرداختن به پیامدهای اخلاقی و امنیتی فناوری و استفاده از مزایای رقابتی آن تعادل برقرار کنند. این تعادل حساس در محوریت قانون هوش مصنوعی اتحادیه اروپا قرار دارد که در مارس ۲۰۲۴ توسط پارلمان اروپا تایید شد. این قانون به منظور ترویج نوآوری و رقابت در اروپا، در عین حفظ شفافیت، پاسخگویی و نظارت انسانی در توسعه و اجرای هوش مصنوعی طراحی شده است.

این قانون رویکردی مبتنی بر ریسک اتخاذ کرده و مقررات لازم را با توجه به سطح ریسک در هر مورد استفاده تعیین میکند. طیف گستردهای از موضوعات با درجههای متفاوتی از اهمیت تحت پوشش این قانون قرار میگیرند؛ از محتواهای ممنوعه و تبعیضآمیز اجتماعی تا زیرساخت، امتیازات اعتباری، جعل عمیق، فیلتر هرزنامهها و بازیهای مبتنی بر هوش مصنوعی.

با وجود این پارامترها، رهبران کسبوکار باید به پایبندی به چارچوب نظارتی و مدیریت ریسک و اعتبار خود توجه کنند و آمادگی نیروی کار خود را برای تغییرات پیش رو و نوآوری بیشتر افزایش بدهند.

چطور با اطمینان کامل از هوش مصنوعی استفاده کنیم؟

دو اولویت اصلی برای رهبران کسبوکار در دستیابی به این هدف وجود دارد. اولی ایجاد استراتژیهای حاکمیت مؤثر برای هوش مصنوعی است که بر پنج اصل استوار است:

- قابلیت توضیحپذیری؛

- انصاف؛

- مقاومت؛

- شفافیت؛

- حفظ حریم خصوصی.

این اصول با هدف ترویج شفافیت در استفاده از دادهها، رفتار عادلانه، دفاع در برابر حملات، شفافیت سیستم و حفاظت از حریم خصوصی طراحی شدهاند. این چارچوب، با نظارت انسانی پشتیبانی میشود و برای کاهش خطرات و اطمینان از اعتمادپذیری سیستمهای هوش مصنوعی به کار میرود. این رویکرد جامع باعث پذیرش مسئولانه هوش مصنوعی، جلب اعتماد کاربران و ذینفعان و در عین حال تضمین استفاده اخلاقی و مسئولانه از فناوریهای هوش مصنوعیمی گردد.

اقدام دوم که اهمیت یکسانی دارد، ایجاد یک هیئت اخلاقی هوش مصنوعی است. اگرچه این قانون خود سطح مشخصی از تبعیت اخلاقی را الزامی میکند، اما کسبوکارها باید از این فرصت برای ایجاد چارچوبهای اخلاقی خود بهره ببرند.

این چارچوب در عین راهنمایی برای استفاده کنونی از هوش مصنوعی، مسیر مشخصی برای نوآوریهای آینده را نیز پایهگذاری میکند. به عنوان مثال، در IBM چارچوب اخلاقی تعیین میکند که در چه مواردی این ابزار را به کار ببریم، با چه مشتریانی کار کنیم و رویکرد معتمدانه ما نسبت به کپیرایت چگونه است. ایجاد این زیرساختها در مراحل اولیه، به جلوگیری از خطرات مربوط به اعتبار یا تخطی از قانون در آینده کمک میکند.

مسئولیت انتقال مهارتها

همچنین وظیفهای آشکار برای تجهیز نیروی کار به مهارتهای لازم برای موفقیت در تحولات هوش مصنوعی وجود دارد. مطالعه اخیر IBM درباره هوش مصنوعی در محیط کار نشان داد که ۸۷٪ از رهبران کسبوکار انتظار دارند حداقل یکچهارم از نیروی کار آنها نیاز به بازآموزی در پاسخ به هوش مصنوعی مولد و خودکارسازی داشته باشند.

افرادی که خود را به مهارتهای هوش مصنوعی مجهز میکنند، در اقتصاد دیجیتال و بازار کار نسبت به دیگران برتری قابل توجهی خواهند داشت. سازمانها مسئولیت دارند که به کارکنان خود در ارتقا یا تغییر مهارتها برای سازگاری با این اکوسیستم در حال تغییر کمک کنند.

کسبوکارها این وظیفه را جدی میگیرند، به طوری که ۹۵٪ از مدیران اجرایی بیان کردهاند که در حال حاضر گامهایی برای اطمینان از داشتن مهارتهای مناسب در حوزه هوش مصنوعی در سازمان خود برداشتهاند، و ۴۴٪ نیز خودشان به طور فعال در حال افزایش مهارتهایشان در این فناوری هستند. انگیزه آنها هم از منظر رقابتی و هم از منظر اجتماعی است، تا اطمینان حاصل شود که بخش بزرگی از نیروی کار از مشارکت و بهرهمندی در اقتصاد دیجیتال پررونق محروم نشوند.

چطور میتوانیم به هوش مصنوعی اعتماد کنیم؟

یقینا اعتماد در مرکز پذیرش موفقیتآمیز هوش مصنوعی قرار خواهد داشت. اعتماد به ما کمک خواهد کرد تا هوش مصنوعی مولد را در مقیاس گستردهتری به کار بگیریم و پتانسیل آن را که به عنوان انقلابیترین فناوری جدید در یک نسل شناخته میشود، محقق کنیم. زمانی که کارکنان با راهحلهای جدید که شبیه به جادو به نظر میرسند، روبرو میشوند، به طور غریزی نسبت به آن تردید میکنند؛ در نتیجه اعتماد باید از همان ابتدا جلب شود.

از آنجا که اعتماد یک عامل حیاتی است، بیایید بررسی کنیم که اعتماد چیست و چگونه بهدست میآید. در سال ۱۹۹۵، استادانی از دانشگاههای نوتردام و پردو مدلی برای اعتماد ارائه دادند که به طور گسترده پذیرفته شده و برای خدمات مبتنی بر هوش مصنوعی بسیار کاربردی است. این مدل نشان میدهد که اعتماد از ادراک توانایی، خیرخواهی و صداقت ناشی میشود. دو رویکرد زیر به درک چالشهای پیش روی ما کمک میکند.

رویکرد اول: استفاده مفیدی از هوش مصنوعی داشته باشید

در ابتدا لازم است بدانید که اعتماد به سیستمهای هوش مصنوعی بر توانایی آنها در حل مشکلات دنیای واقعی استوار است. توانایی برای مفید بودن در یک سناریوی واقعی چیزی نیست که بتوان آن را بدیهی دانست – با وجود نمایش تواناییهای شگفتانگیز از هوش مصنوعی، در بیشتر موارد این تواناییها هنگام استفاده در دنیای واقعی کمی ناامیدکننده بودند. راهحلهای هوش مصنوعی که بیش از حد وعده میدهند و کمتر از انتظار عمل میکنند، در درازمدت مشکلات عمدهای برای اعتماد ایجاد خواهند کرد. ما این موضوع را در چتباتها و دستیارهای صوتی دیدهایم که وعده مکالمه راحتی را میدهند، اما تنها درک محدودی دارند و از درختهای تصمیمگیری ایستا استفاده میکنند. این باعث شد تا کاربران سرخورده شوند و وعدههای این فناوریها محقق نشوند.

برای اینکه سیستمهای هوش مصنوعی در سازمان ها مفید باشند، باید آنها را بر روی مشکلات درست متمرکز کنیم، با دادههای مرتبط و با کیفیت بالا پشتیبانی کنیم و به طور یکپارچه در تجربههای کاربری و جریانهای کاری ادغام کنیم. مهمتر از همه، نظارت و آزمایش مداوم لازم است تا اطمینان حاصل شود که سیستمهای هوش مصنوعی همچنان نتایج مرتبط و با کیفیت ارائه میدهند.

رویکرد دوم: از تأثیر مثبت هوش مصنوعی در سازمانها مطمئن شوید

دومین حوزهای که اعتماد را تقویت میکند، ایده خیرخواهی است. مدلهای هوش مصنوعی باید تأثیر مثبتی بر جامعه، کسبوکارها و افراد بگذارند، وگرنه رد خواهند شد. دو چالش اصلی در این زمینه وجود دارد:

بهرهوری برای ایجاد تأثیر مثبت

باید اطمینان حاصل کنیم که شرکتها هوش مصنوعی را بهطور مسئولانه به کار میگیرند و بهطور کامل تأثیرات منفی را برطرف میکنند. آنها باید از موارد استفاده غیرقابلقبول جلوگیری کنند، حقوق مالکیت فکری را رعایت کنند، رفتار عادلانهای داشته باشند، از آسیبهای محیطی جلوگیری کنند و امکان اشتغال جایگزین را برای کارکنان تحت تاثیر فراهم کنند.

جلوگیری از استفاده مخرب

این کافی نیست که شرکتهای مسئول هوش مصنوعی خیرخواهانه را پیادهسازی کنند؛ بلکه باید از سوءاستفادههای مخرب نیز جلوگیری شود. نهادهای دولتی و نظارتی باید اقداماتی برای تأیید ارائهدهندگان مشروع و حذف بازیگران غیرمسئول انجام دهند. مسائل اصلی شامل اعتبارسنجی ارائهدهندگان، تأیید محتوای واقعی، جلوگیری از حملات جدید مبتنی بر هوش مصنوعی و نظارت بر کانالهای توزیع دیجیتال است.

در نهایت، صداقت زمانی اعتماد ایجاد میکند که کاربران خدمات خود را امن، خصوصی، مقاوم و به خوبی مدیریت شده ببینند. فعالان در حوزه فناوری و شرکتها دههها برای ساخت زیرساختهای بزرگمقیاس و معماریهای بومی ابری، که خدمات دیجیتال حیاتی را پشتیبانی میکنند، وقت صرف کردهاند. شیوههایی که به جهان اجازه میدهد به این خدمات تکیه کند، باید شفاف، متقاعدکننده و سازگار با تواناییهای هوش مصنوعی توسعه داده شوند.

تنها راه برای دستیابی به این صداقت ضروری، استفاده از پلتفرمهایی است که شفافیت، عملکرد، امنیت، حریم خصوصی و کیفیت را در خود جای دادهاند. ایجاد موارد استفاده موازی بر اساس اهداف متمرکز و دادههای مجزا، مسیری خطرناک است که به افزایش هزینه و ریسک، نتایج ضعیف و در نهایت فروپاشی یکپارچگی سیستم منجر خواهد شد.

۶ راهکار برای استفاده مسئولانه از هوش مصنوعی در سازمانها

در حالی که وضوح اهداف یک مزیت است، نمیتوان انکار کرد که با چالشی دشوار روبرو هستیم. پرداختن به موضوع هوش مصنوعی مسئولانه مستلزم همکاری میان بخشهای دولتی و خصوصی در زمینههای مختلف است. همچنین، برای طراحی، مهندسی، اطمینانبخشی و بهرهبرداری از سیستمهای مبتنی بر هوش مصنوعی به شیوهای مسئولانه، ضروریست که روشهای جدیدی درون سازمانها به کار روند. ما این فرصت را نداریم که منتظر بمانیم تا کسی دیگر این چالشها را حل کند. فارغ از نقش و صنعت شما، میتوان مطمئن بود که رقبای شما در حال پیشرفت در پیادهسازی هوش مصنوعی هستند و کارمندان به طور پنهانی از راهحلهای غیرقابلاعتماد استفاده میکنند و بعضا در حال یافتن راههای جدیدی برای حمله و سوءاستفاده از نقاط ضعف هستند.

تجربه در کمک به ساخت هوش مصنوعی مسئولانه در مقیاس سازمانی در صدها سازمان و هسته اصلی کسبوکارها نشان داده است که این ۶ راهکار نقش مهمی در استفاده مسؤلانه از هوش مصنوعی دارند:

۱. همسو شدن رهبری با چشمانداز و مسئولیتهای یکپارچه

هوش مصنوعی یک موضوع در سطح مدیرعامل است که به همکاری میان تمام بخشهای سازمان نیاز دارد. تیمهای رهبری باید در مورد مسائل پیرامون هوش مصنوعی مسئولانه بحث کرده و سپس در مورد حوزههای فرصت، روشهای حاکمیتی، واکنش به تهدیدات و پاسخگویی به اقدامات توافق کنند.

۲. در نظر داشتن عوامل انسانی از ابتدا

تحقیقات شرکت Cognizant نشان میدهد که بیاعتمادی از سوی کارمندان و مصرفکنندگان، در کنار دیگر موارد، میتواند مانع از رشد هوش مصنوعی مولد شود. در حالی که مردم معتقدند هوش مصنوعی مولد تعاملات فناوری را سادهتر و سود شرکتها را افزایش خواهد داد، آنها نگرانند که به نفع کارگران یا جامعه نباشد و باعث ناامنی شغلی شود. کسبوکارها باید این نگرانیها را با شفافیت و ارتباط مستقیم برطرف کنند. این رویکرد نتیجه میدهد، زیرا مطالعه نشان میدهد که اشتیاق به هوش مصنوعی مولد با درک بیشتر از آن افزایش مییابد.

۳. مدیریت استانداردها و ریسکها

ایجاد یک چارچوب حاکمیتی، ریسک و انطباق برای استانداردسازی شیوههای خوب و نظارت سیستماتیک بر فعالیتهای مرتبط با هوش مصنوعی ضروری است. در این چارچوب بایستی به همه جوانب یک سیستم مبتنی بر هوش مصنوعی، از جمله دادههای آموزشی، مدلهای هوش مصنوعی، موارد استفاده از برنامهها، تأثیرات انسانی و امنیت توجه داشته باشید.

۴. ایجاد اجتماعی متمرکز از تخصصها

مدیریت هوش مصنوعی مسئولانه بدون شفافیت و نظارت متمرکز بر فعالیتها ممکن نیست. با ایجاد یک مرکز تخصصی برای هوش مصنوعی، کسبوکارها میتوانند از تخصصهای کمیاب به بهترین شکل استفاده کنند و دیدگاه یکپارچهای به رهبری، ناظران، شرکا، تیمهای توسعه و کارمندان ارائه دهند.

۵. ایجاد ظرفیت و آگاهی

پایداری بهرهمندی مسئولانه از هوش مصنوعی نیازمند آن است که همه افراد در سازمان با تواناییها، محدودیتها و ریسکهای این فناوری آشنا شوند. همه کارکنان باید در مورد هوش مصنوعی، چشمانداز سازمان و فرآیندهای حاکمیتی آن آموزش ببینند. سپس به گروههای منتخب آموزشهای بیشتری داده میشود تا نقش عملیتری در توسعه و استفاده از راهحلهای هوش مصنوعی ایفا کنند.

۶. کدگذاری شیوههای درست استفاده در پلتفرمها

هوش مصنوعی یک فناوری پیشرفته و فراگیر است که تقریباً بر هر نقش شغلی تأثیر خواهد گذاشت. برای اینکه تیمها بتوانند به سرعت راهحلهای قابل اعتماد بسازند، به دادهها و ابزارهای لازم برای انجام این کار نیاز دارند. پلتفرمهای هوش مصنوعی میتوانند داراییهای قابل اشتراک را برای استفاده مجدد در دسترس قرار دهند، اطمینان حاصل کنند که مدیریت ریسک مؤثر در حال انجام است و شفافیت را برای همه ذینفعان فراهم کنند.

نتیجهگیری – با هوش مصنوعی چکار کنیم؟

با وجود چارچوبهای قانونی که اکنون در حال اجرا هستند، مدیران عامل و رهبران ارشد سازمان ها باید چشمانداز در حال تحول هوش مصنوعی را با اعتماد و شفافیت ترسیم، اصول حاکمیت خوب را در توسعه و پذیرش آن ادغام، چارچوبهای اخلاقی را تبیین و نیروی کار خود را آماده کنند. همچنین با بکارگیری ۶ راهکار ذکر شده برای استفاده مسئولانه از هوش مصنوعی، سازمانها آمادگی خواهند داشت تا فعالیتهای هوش مصنوعی را بهطور مؤثر اجرا و مدیریت کنند. در انتها لازم است در نظر داشته باشید که هر سازمانی که هوش مصنوعی را به کار میگیرد یا در معرض تهدیدات مبتنی بر هوش مصنوعی قرار دارد، باید هنگام پیادهسازی آن در ابتدای مسیر مسئولانه اقدام نماید.

مفید و موثر بود